ChatGPT va-t-il faire les devoirs de nos enfants ?

ChatGPT, l’intelligence artificielle conversationnelle développée par OpenAI, défraye la chronique depuis plusieurs mois maintenant. Révolution numérique, multiplicité d’usages, avancée technologique… Les opportunités sont nombreuses, y compris les moins vertueuses. La presse a mis en lumière en début d’année une promotion d’étudiants de l’université de Lyon dont la moitié avait utilisé ChatGPT pour faire leur devoir maison. La supercherie aurait pu fonctionner si tous n’avaient pas rendu des copies similaires…

Nous avons ainsi souhaité tester l’outil en lui soumettant un sujet bien précis : rédiger un plan de dissertation sur la place de l’intelligence artificielle dans le monde contemporain. Voici ce que l’outil d’OpenAI nous a proposé :

Introduction :

- Définition de l’intelligence artificielle (IA)

- Importance croissante de l’IA dans le monde contemporain

- Annonce du plan de la dissertation

I. Les bénéfices de l’IA dans le monde contemporain :

- L’IA dans l’industrie : augmentation de l’efficacité et de la production

- L’IA dans la santé : avancées médicales et diagnostics précis

- L’IA dans les transports : amélioration de la sécurité et de la fluidité du trafic

II. Les limites de l’IA dans le monde contemporain :

- Le risque de remplacement de l’homme par la machine dans certains domaines d’activité

- Les limites éthiques de l’IA : prise en compte de la vie privée et de la protection des données

- Les risques de dérives de l’IA : développement de la surveillance et de la manipulation

III. Les enjeux de l’IA dans le monde contemporain :

- Les opportunités de développement économique et social liées à l’IA

- Les questions de régulation et de contrôle de l’IA pour éviter les dérives

- La nécessité de former les acteurs de la société à l’utilisation de l’IA pour en faire bénéficier le plus grand nombre

Conclusion :

- Synthèse des arguments développés dans les parties précédentes

- Affirmation que l’IA est un enjeu majeur du monde contemporain

- Appel à une utilisation raisonnée et réfléchie de l’IA pour en maximiser les bénéfices et minimiser les risques.

Bluffant ? Oui. Dans l’ensemble, le plan proposé pour une dissertation sur la place de l’intelligence artificielle dans le monde contemporain est bien structuré et présente une analyse assez complète des différents enjeux liés à l’IA. Cependant, quelques éléments peuvent-être améliorés. Et si ChatGPT est capable de nous proposer un plan thématique, peut-être peut-il nous donner son avis sur sa propre production ? Nous lui avons bien entendu posé la question ! Voici son auto-critique :

Tout d’abord, la première partie du plan aborde les bénéfices de l’IA dans le monde contemporain, mais ne présente pas suffisamment les différents domaines d’application de l’IA. Il pourrait être intéressant d’ajouter des sous-parties qui abordent plus en détail les applications de l’IA dans les domaines de l’énergie, de l’agriculture, de l’environnement, etc.

Ensuite, la deuxième partie du plan aborde les limites de l’IA, mais elle pourrait être plus nuancée. Il serait important de rappeler que l’IA peut être bénéfique dans certains cas, mais qu’elle peut aussi poser des risques pour la société et pour les individus. De plus, il serait intéressant d’approfondir la question de la responsabilité de l’IA et de ses créateurs en cas de dérives.

Enfin, la troisième partie du plan aborde les enjeux de l’IA, mais elle pourrait être plus concrète. Il serait important de présenter des exemples concrets de politiques et de régulations en place ou en projet pour encadrer l’utilisation de l’IA, ainsi que des initiatives pour former les acteurs de la société à l’IA.

En conclusion, bien que le plan proposé soit bien structuré et complet, il pourrait être amélioré en ajoutant plus de détails et de nuances dans les différentes parties. En effet, la question de l’IA est complexe et il est important de prendre en compte les différentes dimensions du sujet pour en faire une analyse pertinente et approfondie.

Le constat est le suivant : si ChatGPT peut avoir l’air d’un bon élève, il fait aussi un excellent juge de son propre travail. Alors ChatGPT va-t-il faire les devoirs de nos enfants à leur place ? Mieux, va-t-il pouvoir les corriger ? Voici un petit tour d’horizon non exhaustif des enjeux actuels de l’intelligence artificielle dans le monde de l’éducation en ce début d’année.

ChatGPT, de quoi parle-t-on ?

ChatGPT est une intelligence artificielle qui appartient à la famille des IA génératives. Elle s’appuie sur un réseau de neurones artificiels organisés autour d’une base de données qui compile des informations pour élaborer des réponses construites à des requêtes en imitant la plume humaine. C’est le Deep Neuronal Network.

Finalement, nous avons face à nous, un robot capable d’interagir avec les humains, dans notre propre langage. Les IA peuvent entretenir une conversation en rebondissant sur vos messages précédents et sur l’ensemble de vos réponses.

Rappelons que si cette technologie semble aussi innovante, c’est parce qu’elle alimente un fantasme sur l’entrée dans une nouvelle ère du numérique, une révolution en cours sous nos yeux. Mais, en y regardant de plus près, ChatGPT n’est ni unique ni vraiment révolutionnaire.

Les IA font partie de notre quotidien depuis longtemps. Nous les utilisons tous les jours, la plupart du temps sans même nous en rendre compte. Lorsque vous faites une recherche sur Google ou Bing, quand vous cherchez un film ou une série sur Netflix, ou bien encore quand vous échangez avec un assistant virtuel intelligent comme Alexa, Siri ou Google Assistant…

Yann Le Cun, inventeur du concept d’apprentissage profond (Deep Learning) et spécialiste de l’intelligence artificielle s’est exprimé à ce sujet :

ChatGPT n’est peut-être pas une révolution technologique, mais c’est une révolution d’usage.

Si l’on utilise les IA quotidiennement, ChatGPT est la première à revendiquer un usage vraiment grand public, et c’est à ce titre qu’elle semble plus révolutionnaire que ses cousines.

Pourquoi la vague ChatGPT inquiète la communauté éducative ?

Quelle ne fut pas la surprise générale lorsque la presse titrait que la moitié d’une promotion d’étudiants avait triché pour un devoir en utilisant ChatGPT. Désemparé, l’enseignant a tout de même noté le devoir et accordé la note de 11,75 [à l’intelligence artificielle].

Il aura fallu très peu de temps pour que les étudiants comprennent le potentiel de cet outil. Mais faut-il paniquer ? Finalement, quelle a été la réaction de la communauté éducative à la naissance d’internet ou de Wikipedia ? Nos étudiants seraient-ils devenus médiocres et de vils tricheurs ? Pas vraiment. Alors pourquoi s’intéresser à ChatGPT ?

Le risque de triche

Avec leurs très bonnes capacités de rédaction, ChatGPT et les outils d’intelligence artificielle sont un terrain fertile pour les moins consciencieux d’entre nous. À ce titre et face au risque que les élèves et étudiants s’en remettent entièrement à ces technologies pour leurs productions écrites, la communauté éducative s’interroge.

Certaines universités en France, et même aux Etats-Unis ont tout simplement interdit l’utilisation de ChatGPT à leurs étudiants. Il convient cependant de modérer ces inquiétudes. Si la naissance de Wikipédia et du web en général a provoqué une inquiétude similaire en leur temps, l’intelligence artificielle ne devrait, au final, pas bousculer davantage le paysage scolaire et universitaire.

Des outils existent d’ores et déjà pour détecter l’intervention de ChatGPT dans un texte. Par ailleurs, dans les conditions d’examen actuelles, les tentatives de triche nécessitant le recours à un appareil numérique semblent peu probables. Si, il y a 20 ans, tous nos élèves ne sont pas devenus des tricheurs, ils ont su s’approprier les outils numériques pour gagner en performance et en faire une ressource pertinente.

Avec la bonne approche et en étant accompagnés et formés à utiliser ces technologies à bon escient, parions sur le fait qu’ils sauront faire de même avec l’intelligence artificielle.

La désinformation et les risques de plagiat

Le deuxième risque pourrait être celui de la désinformation. Comme évoqué précédemment, non seulement ChatGPT n’hésite pas à mentir, mais il peut aussi rendre particulièrement crédible une fausse information. Ajoutez à cela une image créée de toute pièce par une IA pour accréditer la thèse et vous obtenez la recette idéale d’une fake news.

Le problème ? La perception sociale de l’intelligence artificielle. Nous avons tendance à y voir un outil neutre et factuel, nourri par une information supposée illimitée. Elle bénéficie donc d’une image positive, associée au progrès et semble, à première vue, extrêmement fiable. Alors si l’intelligence artificielle le dit, c’est sans doute vrai, n’est-ce pas ?

La difficulté réside dans le manque de recul et de sensibilité du public sur le fonctionnement et les limites de ce type d’IA. Au fil des ans, l’intelligence artificielle est passée d’un objet de science-fiction à notre réalité quotidienne. Sauf que le traitement de l’IA dans le cinéma reste encore plutôt éloigné de son stade de développement actuel, chose que les usagers ont encore du mal à percevoir.

Face à ce constat, quels mécanismes utiliser pour garantir la véracité d’une information délivrée par une IA telle que ChatGPT ? Comment former les publics et notamment les plus jeunes à ces enjeux ?

L’arrivée de l’IA dans le paysage pose la question de l’identification des sources dans le milieu scolaire et de la recherche. En effet, en faisant appel à l’IA pour structurer un devoir ou même le rédiger, ChatGPT peut mobiliser des informations sans proposer les sources associées ou pire, relayer des informations obsolètes ou bien encore citer de mauvaises sources.

Le plus important finalement, comme pour toute information qui nous intéresse, c’est de fact checker. Plusieurs solutions s’offrent à vous. Le croisement des sources reste la méthode la plus fiable pour vous forger une opinion. Une autre piste pourrait-être d’interroger ChatGPT sur une source : il est d’ailleurs assez surprenant de constater qu’en la matière, l’IA a de nombreuses choses à dire. Si ChatGPT peut-être une arme redoutable au service des fausses informations, elle est aussi une très bonne défense.

Et pour en apprendre davantage, Numérique Ethique vous propose un parcours pour apprendre à lutter contre les fausses informations !

Comment lutter contre les fake news et adopter de bonnes pratiques ?

Introduction

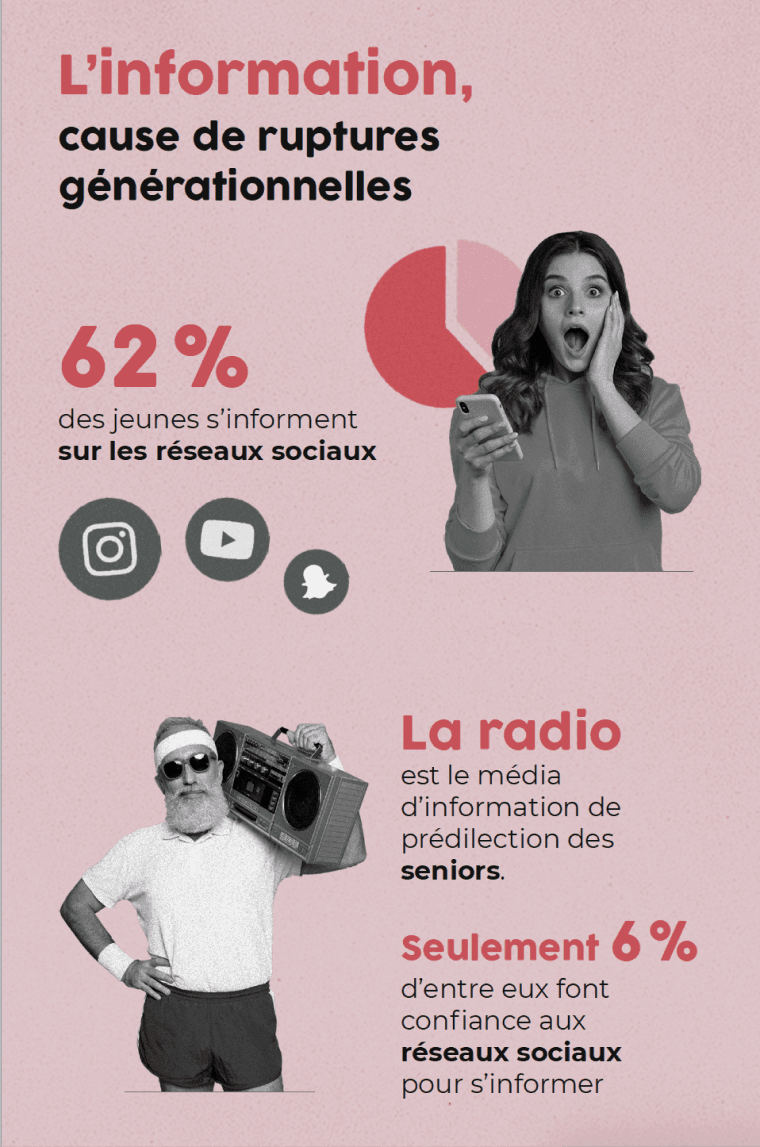

Dans une société où internet a multiplié les moyens de communication et d’information, chaque citoyen doit être en mesure de se forger une opinion éclairée. La maîtrise d’une culture hybride, mêlant le fonctionnement de la presse à celui du numérique, est alors essentielle. Avec à la clé, la capacité à se protéger contre les infox, ces fausses nouvelles qui prospèrent sur internet, et aboutissent à créer une véritable fracture de l’information parmi la population.

Etape 1 : s’informer sur… les origines de la désinformation sur internet

Ah, les “fake news” (fausses informations) ou “infox” ! Vous avez sûrement l’impression d’en avoir largement entendu parler. Avant de rentrer dans le vif du sujet, il convient de prendre un peu de recul et de faire l’état des lieux des pratiques des Français en matière d’information… Nous vous proposons ici de partir en quête des origines de la désinformation qui semble toucher, via le web et les réseaux sociaux, un nombre conséquent de personnes !

Etat des lieux : comment les Français s’informent-ils à l’ère numérique ?

Les risques cyber

Les craintes liées à la cybersécurité sont fondées. Quelques semaines après la sortie de ChatGPT, les hackers et pirates informatiques se sont approprié l’outil à des fins malveillantes, ou simplement pour en tester les limites.

Si certains ont réussi à convaincre ChatGPT de contourner ses propres règles de censure en lui faisant croire qu’elle allait mourir, d’autres s’en servent comme d’un outil au service du cybercrime. Créer des campagnes de phishing crédibles dans une langue étrangère, coder des malwares complexes et plus difficiles à déceler… Voici un panorama non exhaustif des usages malveillants potentiels de ce logiciel.

Si les particuliers doivent garder ce risque à l’esprit pour s’en protéger, les institutions, de plus en plus touchées par des cyberattaques, doivent également redoubler de vigilance. Et si l’IA était utilisée pour mettre au point des attaques informatiques destinées à voler les données d’une institution, violer le secret professionnel ou encore s’approprier des travaux de recherche ou encore des brevets ? Ces considérations doivent nous pousser à nous interroger sur les moyens de garantir la propriété intellectuelle.

Enfin, ces outils numériques stockent l’ensemble des données et documents liés à vos requêtes et les mettent à disposition d’une entreprise privée américaine : OpenAI. On ignore toujours dans quelle mesure ChatGPT peut utiliser ces ressources lors de conversations avec d’autres utilisateurs, ou être exploitées par ses propriétés à toute autre fin d’ailleurs.

Quelles sont nos armes de défense face à ces risques ?

Les institutions

S’il est bien un organe compétent et légitime pour identifier les risques et agir pour réguler le secteur du numérique au service de l’intérêt général, c’est l’Etat.

Les pouvoirs publics doivent embrasser l’arrivée de l’Intelligence artificielle et mettre en place des politiques pour garantir la sécurité des données et réguler les usages abusifs et nuisibles de l’IA. Identifier les attaques informatiques créées par des IA, créer des protocoles pour les prévenir et proposer des outils pour déceler les mauvais usages des IA génératives sont des domaines que les pouvoirs publics vont devoir investir rapidement, dans une discipline qui évolue elle-même très vite.

C’est d’ailleurs déjà le cas de la Commission Nationale Informatique et Libertés (CNIL) qui s’est dotée d’une cellule spécialisée dans l’étude du fonctionnement de l’intelligence artificielle. Elle pourra ainsi mieux identifier les risques et les opportunités liés à ces outils.

Les outils numériques

Produits par des utilisateurs ou par les sociétés mères des intelligences artificielles, il existe des outils numériques capables d’identifier les textes ou images produits par les IA. Ils sont déjà disponibles et accessibles au plus grand nombre.

Dans le cas de ChatGPT, l’outil le plus fiable est celui de la société OpenAI : AI Text Classifier. En cas de doute, passez des extraits de texte au crible ! À noter que ces outils ne sont, pour la plupart, pas encore totalement fiables, ils sont d’ailleurs pour certains déjà obsolètes en raison de la vitesse d’évolution de ChatGPT (c’est le cas de Detech GPT). L’outil développé par OpenAI reste toutefois le plus performant grâce à l’ajout d’une clef de chiffrage dans les productions de ChatGPT.

AI Text Classifier devrait évoluer dans les prochains mois pour devenir plus performant pour permettre notamment d’analyser des textes de plus en plus longs. Et si finalement le meilleur outil pour prévenir les risques liés à l’IA, c’était l’IA elle-même ? Au-delà de la détection des textes générés par ChatGPT, elle pourrait être la solution pour développer des outils numériques destinés à lutter contre la cybercriminalité ou encore le plagiat…à condition bien sûr que ces outils restent librement accessibles.

Des usages raisonnés

Pour identifier et prévenir les risques liés à l’usage de ces outils technologiques, la meilleure méthode reste la formation et l’éducation. Il est d’ores et déjà primordial de sensibiliser tous les publics, scolaires, professionnels ou citoyens, à la bonne utilisation de ChatGPT et des IA en général.

Protéger ses données et ne pas révéler son identité sur ChatGPT pour prévenir la circulation de ces informations, recourir à l’IA conversationnelle pour enrichir et confronter ses propres productions, comprendre les limites de ces outils et rationaliser leur perception pour prévenir le plagiat… Voici une liste non exhaustive desujets qui devraient nous occuper tout prochainement.

Un apprentissage dès l’école pour embrasser le progrès

Au même titre que le codage informatique fait aujourd’hui partie des programmes scolaires, l’ONU recommande d’intégrer les grands enjeux et l’usage de l’intelligence artificielle dans les programmes scolaires.

Elle suggère une approche en trois axes :

- l’intégration de l’IA dans les outils d’apprentissages

- une approche sur les principes éthiques de l’IA

- un cadre d’orientation sur les compétences en IA pour les élèves.

Une approche globale de l’intelligence artificielle au service de l’apprentissage et des savoirs de demain. Cette base devrait permettre au plus grand nombre d’être à minima sensibilisé au fonctionnement et aux risques de l’intelligence artificielle.

Le mot de la fin…?

Finalement, après l’émulation liée à l’arrivée de ChatGPT dans nos vies quotidiennes, nous découvrons progressivement ses limites, ses opportunités et ses risques. Les acteurs étatiques, institutionnels, la société civile… Tous devront se saisir de ces enjeux pour s’approprier ces outils et les mettre au service d’une société du progrès. Promis, tout cela, c’est nous qui l’avons écrit !

Pour aller plus loin :

Intelligence artificielle : histoire et prospectives

Les machines vont-elles un jour nous dominer ? A quoi ressemblera notre monde bardé de connexions, d’algorithmes et de données infinies dans 30 ans ? Le point sur ces sujets avec Dominique Cardon.

En juin dernier, MAIF recevait M. Dominique Cardon, Professeur de sociologie et directeur du Medialab à Sciences Po Paris. Durant cette conférence, à retrouver en version complète sur YouTube, il nous partage sa vision de l’impact de l’intelligence artificielle dans notre quotidien.

Après une introduction sur l’histoire d’une science encore peu comprise du grand public, l’auteur de Culture Numérique - son ouvrage paru en 2019 - nous ouvre les yeux sur la nécessité de l’IA, si tant est qu’elle soit éthique et responsable.

Un sujet passionnant qui nous plonge dans le monde de la donnée, du calcul et de la prédiction.

Qu’appelle-t-on Intelligence Artificielle ?

L’IA est une technique particulière de Machine Learning, s’appuyant sur des réseaux de neurones, le Deep Learning.

Ces différents termes peuvent paraître complexes, voire ne rien vous évoquer, et à juste titre : ce sont des sciences informatiques nées à la suite de décennies d’innovations et de recherches.

Afin de mieux comprendre les sujets évoqués par Dominique Cardon, il semble toutefois pertinent de les définir. En voici une version simplifiée :

- Intelligence artificielle : Ensemble des théories et des techniques mises en œuvre en vue de réaliser des machines capables de simuler l’intelligence humaine (1).

- Machine Learning : Le Machine Learning ou apprentissage automatique est un domaine scientifique, et plus particulièrement une sous-catégorie de l’intelligence artificielle. Il consiste à laisser des algorithmes découvrir des “patterns”, à savoir des motifs récurrents, dans les ensembles de données. Ces données peuvent être des chiffres, des mots, des images, des statistiques. Tout ce qui peut être stocké numériquement peut servir de donnée pour le Machine Learning (2).

- Deep Learning : Le deep learning ou apprentissage profond est un type d’intelligence artificielle dérivé du machine learning (apprentissage automatique) où la machine est capable d’apprendre par elle-même, contrairement à la programmation où elle se contente d’exécuter des règles prédéterminées (3).

Il est toutefois important de noter que tous les chercheurs impliqués dans ces sciences ne sont pas forcément d’accord sur un consensus de définitions et d’objectifs de l’IA.

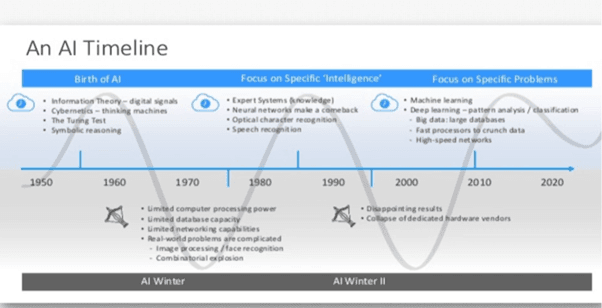

Une histoire d’innovations et de désaccords scientifiques

Tout commence en 1956 lors du Summer Workshop de Dartmouth. C’est à cette occasion que 15 chercheurs, surnommés les Pères Fondateurs de l’IA, se réunissent pour mutualiser leurs recherches. L’intérêt du grand public commence à se faire sentir.

Les années 1960 marquent un tournant. On y apprend notamment que plusieurs courants ont commencé à s’opposer, allant jusqu’à se livrer une véritable bataille de l’innovation.

John McCarthy, créateur du terme “intelligence artificielle”, a pour idée de rendre les machines intelligentes. Il compte donner aux robots la capacité de raisonner et de décider. Cette vision de l’IA dominera une grande partie de l’histoire.

Face à lui, Doug Engelbart, qui est l’un des grands inventeurs de l’ordinateur personnel, lance l’ARC, l’Augmentation Research Center. Son idée est d’augmenter l’intelligence des humains grâce aux machines.

Symbolique ou Connexionniste ? L’affrontement des IA

Pour simplifier l’histoire de l’IA, on peut dire que 2 courants se sont affrontés.

- L’IA symbolique : une manière de permettre à l’ordinateur de raisonner et de reproduire un raisonnement humain.

- L’IA connexionniste : on part ici du principe que la machine n’est pas intelligente. Elle perçoit à travers les données (Big Data) des relations qui lui permettent de produire toute une série de perceptions. C’est le courant qui domine de nos jours.

Quelle est l’utilité de l’IA ?

La technologie de l’intelligence artificielle offre plusieurs avantages cruciaux qui en font un excellent outil pour pratiquement toutes les organisations modernes :

- Automatiser une tâche répétitive qui était auparavant effectuée manuellement, sans ressentir de fatigue ou devoir prendre de pauses (comme un employé humain devrait le faire).

- Rendre les produits et les services plus intelligents et plus efficaces, en améliorant les expériences des utilisateurs finaux (conversation, service client, meilleures recommandations de produits).

- Analyse de données à un rythme beaucoup plus rapide que les humains, permettant de croiser des ensembles de données beaucoup plus importants que ce que peuvent faire les humains.

- Récolter et interpréter des données de manière plus précise que les humains, pour prendre de meilleures décisions. Par exemple pour choisir un investissement financier ou identifier une excroissance cancéreuse sur des radiographies.

Globalement, l’IA permettrait ainsi aux organisations de prendre de meilleures décisions, améliorant les processus de base en augmentant à la fois la vitesse et la précision des tâches accomplies.

L’exemple des plateformes de streaming

Spotify et Deezer sont les deux leaders du marché du streaming musical. Leurs algorithmes utilisent l’intelligence artificielle pour traquer toutes nos actions sur la plateforme. Les musiques que nous écoutons, celles que nous passons, les styles que nous n’écoutons jamais, etc. Ainsi, il apprend et met à jour constamment nos données comportementales. Finalement, ces applications établissent un profil utilisateur le plus précis possible, pour proposer un contenu optimisé selon nos goûts musicaux grâce à l’IA.

Conclusion

Alors, les hommes se feront-ils vraiment remplacer par les machines ? Que restera-t-il de notre sens critique lorsque chaque information qui nous parvient sera ultra-personnalisée ?

Les études d’historiens de l’économie réalisées depuis 30 ans n’ont jamais vu le marché de l’emploi se réduire avec toutes les vagues d’automatisation (machines-outils, informatique, etc.). Les paysans équipés de fourches sont devenus des ouvriers munis d’outils, rendant leur travail plus productif et moins pénible.

A l’heure actuelle, certaines prévisions sont pourtant assez alarmistes : dans 20 ans, 42 % des emplois en France pourraient disparaître. L’OCDE tempère toutefois ces conclusions en indiquant que 10 % des emplois “seulement” seraient voués à véritablement disparaître, tandis qu’environ 50 % de ces emplois seraient plutôt amenés à évoluer.

(Re)voir la conférence

Un nouveau monde de la donnée, du calcul et de la prédiction est en train de se mettre en place. Et forcément, cela nous intrigue. Alors pour continuer votre aventure au pays de la data, vous pouvez visionner l’intégralité de l’intervention de Dominique Cardon, disponible sur la chaîne YouTube de la MAIF : Intelligence artificielle : histoire et prospectives.

Partager sur :